BTC/HKD+0.23%

BTC/HKD+0.23% ETH/HKD+0.64%

ETH/HKD+0.64% LTC/HKD+0.82%

LTC/HKD+0.82% ADA/HKD+1.85%

ADA/HKD+1.85% SOL/HKD+0.99%

SOL/HKD+0.99% XRP/HKD+1.09%

XRP/HKD+1.09%編輯:LRS

注意力機制這么好用,怎么不把它塞到卷積網絡里?最近MetaAI的研究人員提出了一個基于注意力的池化層,僅僅把平均池化層替換掉,就能獲得+0.3%的性能提升!

VisualTransformer作為計算機視覺領域的新興霸主,已經在各個研究任務中逐漸替換掉了卷積神經網絡CNN。

ViT與CNN之間存在著許多不同點,例如ViT的輸入是imagepatch,而非像素;分類任務中,ViT是通過對類標記進行決策等等。

classtoken實際上是ViT論文原作者提出,用于整合模型輸入信息的token。classtoken與每個patch進行信息交互后,模型就能了解到具體的分類信息。

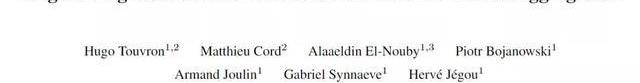

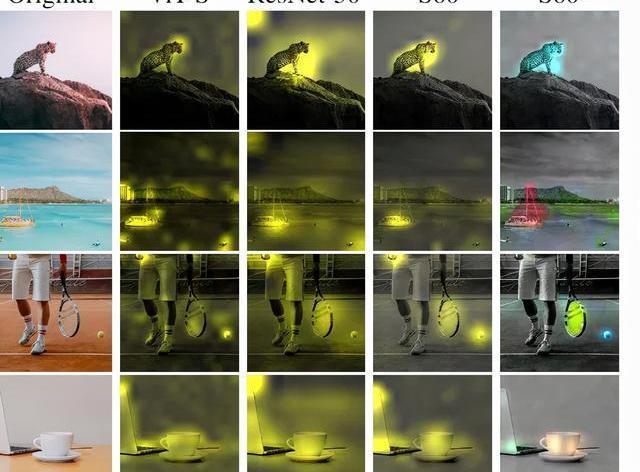

并且在自注意力機制中,最后一層中的softmax可以作為注意力圖,根據classtoken和不同patch之間的交互程度,就能夠了解哪些patch對最終分類結果有影響及具體程度,也增加了模型可解釋性。

但這種可解釋性目前仍然是很弱的,因為patch和最后一層的softmax之間還隔著很多層和很多個header,信息之間的不斷融合后,很難搞清楚最后一層softmax是否真的可以解釋分類。

Web3社交層DeSo將推出2.0版本:金色財經報道,Web3社交層和Layer1網絡DeSo宣布即將推出2.0版本,目前已公布權益證明系統Revolution。此外,還有Production Fast-Hotstuff、主權質押、Liquid Bonding、Collaborand等更新。[2023/3/24 13:24:01]

所以如果ViT和CNN一樣有視覺屬性就好了!

最近MetaAI就提出了一個新模型,用attentionmap來增強卷積神經網絡,說簡單點,其實就是用了一個基于注意力的層來取代常用的平均池化層。

仔細一想,池化層和attention好像確實很配啊,都是對輸入信息的加權平均進行整合。加入了注意力機制以后的池化層,可以明確地顯示出不同patch所占的權重。

并且與經典ViT相比,每個patch都會獲得一個單一的權重,無需考慮多層和多頭的影響,這樣就可以用一個簡單的方法達到對注意力可視化的目的了。

FTX將采取行動從1500個巴哈馬賬戶追回1億美元:12月15日消息,美國國會已經拿到了一份1500名巴哈馬FTX用戶的名單,這些人在11月10日至11日大約25小時內從FTX提取了資金,FTX總部位于巴哈馬,許多重要員工都居住在那里,包括SBF和Alameda Research首席執行官Caroline Ellison。但當時FTX已經暫停了對其他地區的提款功能,據稱從巴哈馬賬戶中提取的總金額達到了1億美元。

在最新的聽證會上,FTX現任首席執行官John Jay Ray III表示,肯定會采取一些行動來追回這筆錢。(Blockworks)[2022/12/15 21:46:46]

在分類任務中更神奇,如果對每個類別使用不同顏色進行單獨標記的話,就會發現分類任務也能識別出圖片中的不同物體。

數據:約2.5萬枚ETH從幣安轉入未知錢包:金色財經報道,WhaleAlert監測數據顯示,北京時間11:47:33,25709枚ETH從幣安轉入未知錢包,價值約3244萬美元。[2022/12/7 21:27:55]

基于Attention的池化層

文章中新提出的模型叫做PatchConvNet,核心組件就是可學習的、基于attention的池化層。

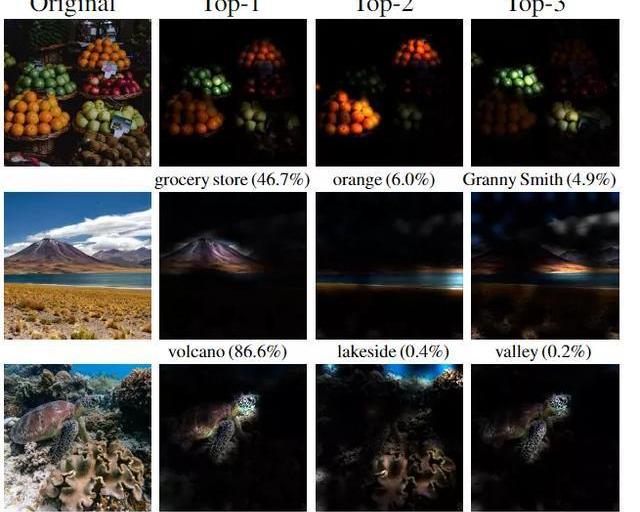

模型架構的主干是一個卷積網絡,相當于是一個輕量級的預處理操作,它的作用就是把圖像像素進行分割,并映射為一組向量,和ViT中patchextraction操作對應。

最近也有研究表明,采用卷積的預處理能讓模型的性能更加穩定。

美聯儲鮑曼:如果通脹沒有降溫,仍有可能“大幅”加息:金色財經報道,美聯儲理事鮑曼(Michelle Bowman)周三表示,如果高通脹率沒有開始減弱,她將繼續支持積極的利率上升。她說:“通貨膨脹率太高了,我堅信,將通貨膨脹率拉回到我們的目標,是實現價格穩定和在可持續基礎上實現最大就業目標的一個必要條件。”

鮑曼表示,通貨膨脹的情況將決定美聯儲的下一步計劃。如果沒有看到通脹率下降的跡象,我的觀點仍然是,聯邦基金利率目標范圍內的可觀增長應該仍在考慮之列。但她也表示,如果通貨膨脹開始降溫,放慢加息步伐是合適的。

此外,鮑曼稱,為了以持續和持久的方式使通貨膨脹率下降,聯邦基金利率將需要升至一個限制性水平,并在那里保持一段時間。(路透社)[2022/10/13 14:26:08]

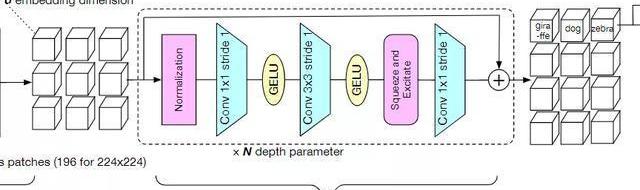

模型的第二部分column,包含了整個模型中的大部分層、參數和計算量,它由N個堆疊的殘差卷積塊組成。每個塊由一個歸一化、1*1卷積,3*3卷積用來做空間處理,一個squeeze-and-excitation層用于混合通道特征,最后在殘差連接前加入一個1*1的卷積。

美股三大指數集體收跌,標普500指數跌2.8%,本周累漲1.51%:金色財經報道,美股三大指數集體收跌,納指跌3.8%,本周累漲0.73%;標普500指數跌2.8%,本周累漲1.51%;道指跌2.11%,本周累漲1.99%。[2022/10/8 12:49:05]

研究人員對模型塊的選擇也提出了一些建議,例如在batchsize夠大的情況下,BatchNorm往往效果比LayerNorm更好。但訓練大模型或者高分辨率的圖像輸入時,由于batchsize更小,所以BatchNorm在這種情況下就不太實用了。

下一個模塊就是基于注意力的池化層了。

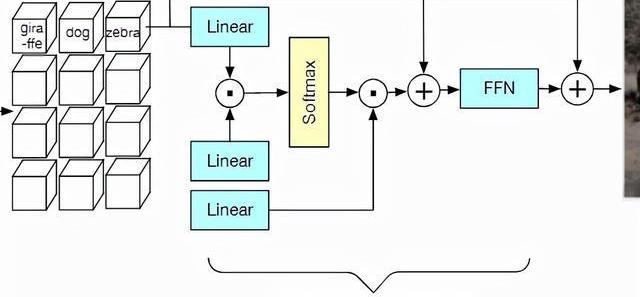

在主干模型的輸出端,預處理后的向量通過類似Transformer的交叉注意力層的方式進行融合。

注意力層中的每個權重值取決于預測patch與可訓練向量之間的相似度,結果和經典ViT中的classtoken類似。

然后將產生的d維向量添加到CLS向量中,并經過一個前饋網絡處理。

與之前提出的class-attentiondecoder不同之處在于,研究人員僅僅只用一個block和一個head,大幅度簡化了計算量,也能夠避免多個block和head之間互相影響,從而導致注意力權重失真。

因此,classtoken和預處理patch之間的通信只發生在一個softmax中,直接反映了池化操作者如何對每個patch進行加權。

也可以通過將CLS向量替換為k×d矩陣來對每個類別的attentionmap進行歸一化處理,這樣就可以看出每個塊和每個類別之間的關聯程度。

但這種設計也會增加內存的峰值使用量,并且會使網絡的優化更加復雜。通常只在微調優化的階段以一個小的學習率和小batchsize來規避這類問題。

實驗結果

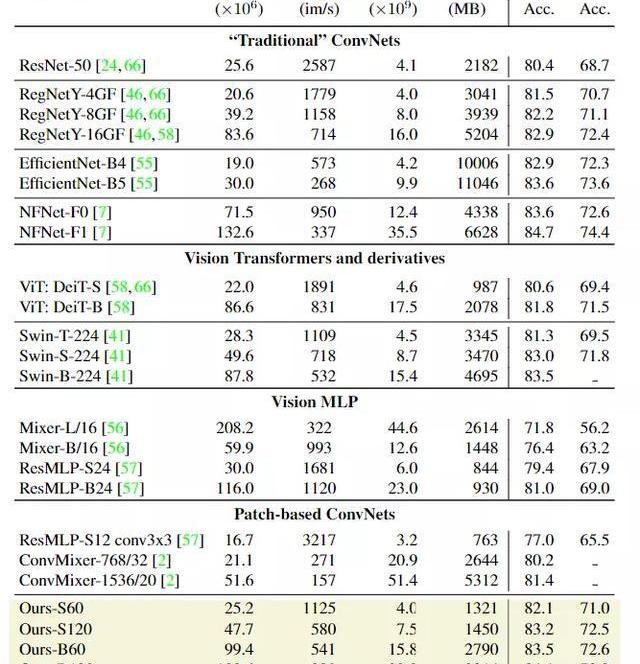

在圖像分類任務上,研究人員首先將模型與ImageNet1k和ImageNet-v2上的其他模型從參數量,FLOPS,峰值內存用量和256張圖像batchsize下的模型推理吞吐量上進行對比。

實驗結果肯定是好的,可以看到PatchConvNet的簡單柱狀結構相比其他模型更加簡便和易于擴展。對于高分辨率圖像來說,不同模型可能會針對FLOPs和準確率進行不同的平衡,更大的模型肯定會取得更高的準確率,相應的吞吐量就會低一些。

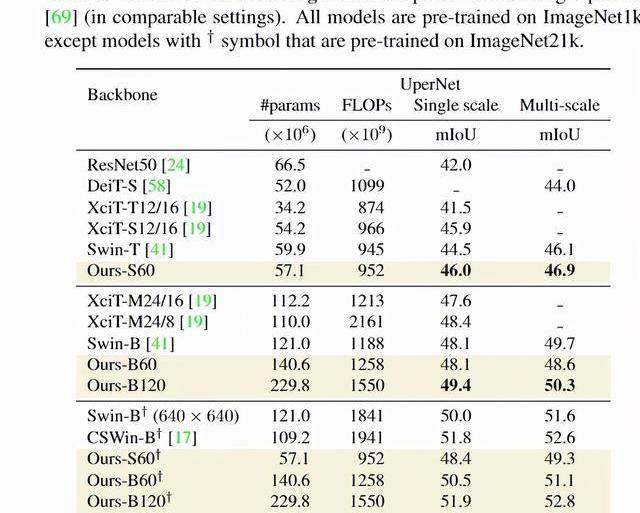

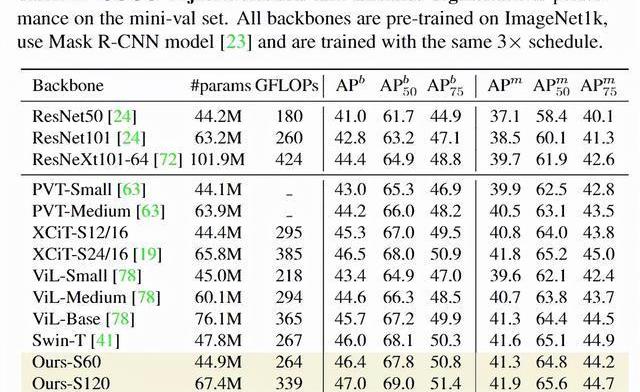

在語義分割任務上,研究人員通過ADE20k數據集上的語義分割實驗來評估模型,數據集中包括2萬張訓練圖像和5千張驗證圖像,標簽超過150個類別。由于PatchConvNet模型不是金字塔式的,所以模型只是用模型的最后一層輸出和UpperNet的多層次網絡輸出,能夠簡化模型參數。研究結果顯示,雖然PatchConvNet的結構更簡單,但與最先進的Swin架構性能仍處于同一水平,并且在FLOPs-MIoU權衡方面優于XCiT。

在檢測和實例分割上,研究人員在COCO數據集上對模型進行評估,實驗結果顯示PatchConvNet相比其他sota架構來說,能夠在FLOPs和AP之間進行很好的權衡。

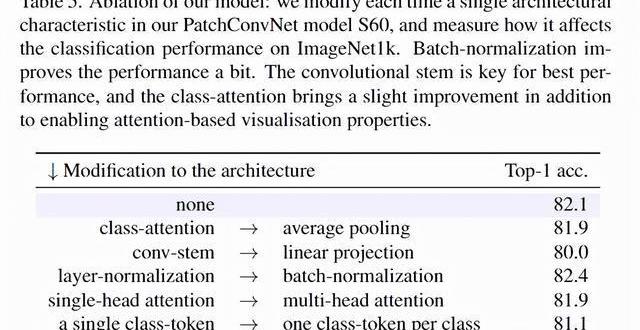

在消融實驗中,為了驗證架構問題,研究人員使用不同的架構對比了Transformer中的classattention和卷積神經網絡的平均池化操作,還對比了卷積主干和線性投影之間的性能差別等等。實驗結果可以看到卷積主干是模型取得最佳性能的關鍵,class-attention幾乎沒有帶來額外的性能提升。

另一個重要的消融實驗時attention-basedpooling和ConvNets之間的對比,研究人員驚奇地發現可學習的聚合函數甚至可以提高一個ResNet魔改后模型的性能。

通過把attention添加到ResNet50中,直接在Imagenet1k上獲得了80.1%的最高準確率,比使用平均池化層的baseline模型提高了+0.3%的性能,并且attention-based只稍微增加了模型的FLOPs數量,從4.1B提升到4.6B。

參考資料:

https://arxiv.org/abs/2112.13692

證券時報微信公號1月21日消息,據媒體報道,今日頭條、抖音及TikTok母公司字節跳動2021年全年收入約為580億美元,同比增長70%.

1900/1/1 0:00:002022年1月4日,數字人民幣試點版APP正式上線!中國成為世界上第一個普及法定數字貨幣的國家.

1900/1/1 0:00:00基金、盲盒、超前點播、網紅雪糕、直播打賞、玲娜貝兒.....這些被網友戲稱為2021年十大“肉疼”的剁手項目,你都做過哪些?不過網警蜀黍發現,還有一種讓你“肉疼”的東西,一不小心你就會血本無歸.

1900/1/1 0:00:00小品界里宋丹丹和趙本山這對金牌搭檔可謂是春晚舞臺上的常客,他們兩合作了無數膾炙人口的小品。在《小崔說事》里,說到白云出的書,黑土形象地把這本沒人看的書比喻成了廁紙,書籍印刷出來自然是給人看的,但.

1900/1/1 0:00:00原標題:《淄博產業快訊:元宇宙是否能夠成為數字產業中的獨角獸》元宇宙是一個新的世界,人們參與其中并生活在數字身份中。元宇宙是一個不斷發展的多元宇宙。解釋的概念.

1900/1/1 0:00:00自從今年元宇宙的風吹起來后,元宇宙的浪潮短短幾個月時間席卷了各行各業,街頭巷尾。截至今日,據天眼查數據顯示,元宇宙相關商標申請量已超過4400條,申請元宇宙相關商標的企業數量超過700家.

1900/1/1 0:00:00